核心摘要:在 2026 年,单纯依赖 VPS 服务商的“系统快照”等同于让数据“裸奔”。机房失火、硬盘损坏或误操作随时可能让你的网站灰飞烟灭。本文将硬核拆解如何利用免费的 Google Drive 或 OneDrive 空间,结合 Rclone 命令行或宝塔面板插件,搭建一套零成本、全自动、抗造的异地数据库与网站源文件灾备系统。教程涵盖 Token 续签机制、规避 API 封禁、单文件加密打包、防锁表及防进程密码泄露等核心避坑指南。

老实说,在 2026 年还有人在给服务器“裸奔”,或者单纯指望和依赖 VPS 服务商的“系统快照”,胆子是真的大。不管你是用搬瓦工、斯巴达还是 RackNerd,如果你连一个像样的异地灾备都没有做,那你就是在和运气对赌。机房失火、硬盘损坏、商家意外跑路,或是自己手贱一个 rm -rf /*,都有可能让你辛苦几年运营的 WordPress 博客、外贸独立站数据瞬间灰飞烟灭。企业级的异地灾备(如 AWS S3,阿里云 OSS)虽然稳健,但对于我们个人站长、外贸玩家来说,不仅配置繁复,带宽费用和存储按量计费也是一笔不小的开销。

其实,你完全不需要在备份上花费真金白银。利用你手头闲置的免费 Google Drive(拥有 15GB 免费空间)或是 OneDrive(Office 365 赠送 1TB 或 E5 白嫖账户),再加上几行简单的自动化脚本或控制面板插件,就能搭建一套零成本、全自动、抗造的异地数据避风港。这套方案配置好之后,属于“一次设置,终身受益”,哪怕服务器瞬间爆炸,我们也能在几十分钟内满血复活。老兄,如果你还在到处寻找靠谱的备份服务,这篇长篇级、保姆级实战教程绝对能帮你打通 VPS 联盟里面的核心生存法则。

在这篇文章中,我们将深度解析如何将服务器上的 MySQL/MariaDB 数据库以及网站源文件,通过不同的手段(命令行或面板环境)全自动同步到 Google Drive 和 OneDrive。不仅给出操作步骤,我们还会点破其中的“黑话”与坑点,保证你的数据做到真正的万无一失。

📊 主流云盘备份策略与方案横评

在动手实操前,我们先看看目前市面上有哪些可玩的手段。直接看下面这张图表分析,这三种路径决定了你要投入的学习成本和产出效果。

🔥 主流云盘数据库备份方案 PK专家强烈推荐 Rclone

| 备份方案 | 学习成本 | 安全与加密支持 | 灵活性与调度机制 | 核心适用群体 |

|---|---|---|---|---|

| Rclone + Crontab脚本 | ⭐高 (需懂Linux) | 支持高级流加密,无死角 | 极高 (按秒定制、不限结构) | 硬核发烧友/独立VPS |

| 宝塔/1Panel 云盘插件 | ⭐低 (图形界面) | 需设压缩包密码,易被爆破 | 一般,受限于面板版本设置 | 非技术向建站站长 |

| UpdraftPlus (WP插件) | 无脑一键绑定 | 较弱 (依赖WP自身安全性) | 仅限 WordPress 特定目录 | 纯 WP 博主小白 |

如果你是拿来跑中轻度 WP 博客或者外贸站,想要一劳永逸并且掌控所有底层数据逻辑,那么放弃花哨的插件,选用 Rclone + 自动化脚本 是永远滴神。

🧠 核心原理解析与前置技术说明

很多站长以前尝试用过一些脚本直接往网盘上传文件,但往往跑了几天就失效了。这里涉及到几个极其重要的云计算“黑话”(Signals)和规则,想要用得稳,必须懂底层的逻辑。

OAuth 2.0 授权与 Token 刷新机制:

当你授权一个应用程序(如 Rclone 或宝塔插件)访问你的 Google Drive 时,网盘不会直接保存你的账号密码,而是颁发一个 Access Token 和 Refresh Token。Access Token 通常只能存活几个小时。很多小白的备份失败,就是因为工具没有自动处理 Refresh Token 导致的死锁。我们推荐的 Rclone 和正规面板插件,其核心优势就是自带极度健壮的 Token 续签功能。

API 速率限制 (Rate Limits):

千万不要把网站成千上万个极小的文件(图片、缓存碎片代码)直接往 Google Drive 或 OneDrive 上面同步!云盘的 API 接口通常有严格的请求频率限制。如果直接执行同步整个目录的命令,不出半小时你的账号就会被触发 Rate Limit 进而被封禁 API 访问权限。

最佳解法: 把网站文件和数据库先在本地 .tar.gz 打包成一个整体的压缩包,随后针对这个单一文件进行上传请求。

“快照全量”与“数据库增量”:

不要尝试在这类免费网盘上玩数据库二进制日志(Binlog)的实时级增量同步。那只适合专业的多云架构节点。我们的思路是每天凌晨利用计划任务进行一次“快照全量打包”,按日期命名并抛到网盘上,超过一定期限的数据直接删除。大道至简,对于个人站点的 RTO(恢复时间目标)已经完全足够。

💡 vps1111 避坑指南(关于白嫖云盘的隐患):

- 空间限制警戒线:Google Drive 免费版只有 15GB,建议配合

find命令定期删除 7 天或 15 天前的老备份;OneDrive E5 虽大,但若使用率过低或被判定为纯冷备盘,触发微软风控不仅数据清空还会封号,务必做好多云分发。 - 锁表黑洞:备份数据库时如果是高并发建站,执行

mysqldump可能会导致死锁(即网站因为备份而短暂掉线打不开)。务必在导出命令中加上--single-transaction参数以规避这一致命坑点! - 数据极致隐私与黑客防御:备份包一旦传到公有云,若网盘密码泄露,数据库敏感信息完全暴露。强烈建议在打包时加上

openssl加密,或者使用 zip 强密码加密!

🛠️ 第一阶段:硬核极客首选方案 —— Rclone 挂载与全自动流式同步

如果你有纯洁的 SSH 连接,并且使用 LNMP、运行 Docker,不用任何面版环境,这套 Rclone 的玩法可以让你彻底解放。Rclone 被誉为“管理云存储的瑞士军刀”,它能通过命令行调用主流网盘的 API。

1. 一键安装 Rclone 核心组件

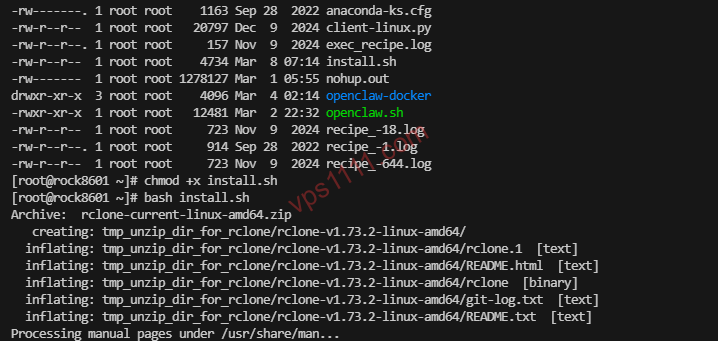

使用官方一键安装脚本,无论你是 Ubuntu 还是 CentOS 都稳如老狗,直接在 SSH 执行:

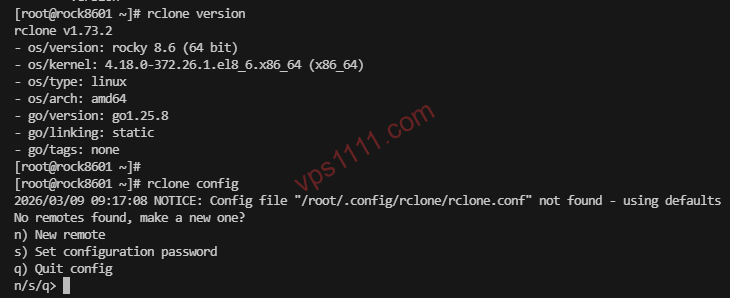

curl https://rclone.org/install.sh | sudo bash安装完成后,输入 rclone version 检查是否有版本号输出。

2. 配置 Google Drive 或 OneDrive 授权接入

这里是最容易卡住小白的地方:因为我们的 VPS 大多是没有图形界面的(Headless 服务器),无法打开浏览器让你点击“授权登录”。所以我们需要利用本机电脑做一下桥接。

步骤大纲:

输入命令进入交互式选单:

rclone config- New remote: 输入一个新的连接名称,例如我们起名叫

gdrive或者onedrive。 - Storage Type: 列表会很长。如果你选 Google Drive,一般是输入对应的序列号(通常是

18左右)。如果选 OneDrive,一般是31(请以实际最新提示数字为准)。 - Client ID / Client Secret: 这里直接敲回车跳过,默认使用 Rclone 公用的 API。但出于稳定性,强烈建议后续去 Google Cloud Console 自己申请专属密钥(进阶操作)。

- Scope: 选

1(赋予全局读写权限)。 - Use auto config?: 系统会问你是否使用自动配置。关键:选

N(否),因为我们没有浏览器!

接着系统会给你一段指引命令:

For this to work, you will need rclone available on a machine that has a web browser available.

意思是:你需要在一台有桌面版系统的机器(比如你的本地电脑)下载一个本地版的 rclone 工具,在 cmd 里输入它提示的那条命令:rclone authorize "drive" "xxxxxxxx"。

随后本地机器会弹出浏览器窗口,你登录云盘账户完成授权同意后,命令提示符里会返回一长串极为关键的 Token JSON 代码。

复制这段超长的代码,粘回到 VPS 服务器等待授权的那一步即可完成挂载。

3. 编写自动化灵魂骨架:核心 Shell 脚本

有了 Rclone 环境,我们需要告诉服务器“应该打包什么?打包完存在哪里?如何扔给网盘?”

我们在 VPS 的 /root 目录下建立一个专用脚本:

mkdir -p /root/scripts

mkdir -p /root/backup_temp

nano /root/scripts/auto_backup.sh直接把下面的核武器级别代码修改为你自己的配置并粘贴进去。(注意这里采用了环境变量传密码的高级安全规范,杜绝了 ps 进程泄露数据库密码的风险):

#!/bin/bash

# ==========================================

# 自动化数据库与网站源代码备份推送到 Google Drive

# ==========================================

# 1. 变量定义区(替换成你自己的数据)

DB_USER="root"

# 核心安全规范:通过环境变量传递密码,防止被 ps -ef 截获及消除命令行警告

export MYSQL_PWD="你的数据库高级密码"

DB_NAME="你的数据库名"

# 如果你想备份网站文件,填入完整路径

WEB_DIR="/var/www/html"

# Rclone 挂载的名称和网盘存放路径

RCLONE_REMOTE="gdrive:ServerBackup"

# 临时保存的目录(一定要提前建好)

BACKUP_DIR="/root/backup_temp"

# 生成日期时间标签

DATE=$(date +"%Y%m%d_%H%M%S")

DB_FILE="$BACKUP_DIR/db_$DB_NAME_$DATE.sql"

ARCHIVE_FILE="$BACKUP_DIR/full_web_backup_$DATE.tar.gz"

echo "[开始] $(date) - 触发大规模防爆备份流程"

# 2. 导出数据库(避坑要领:加入 --single-transaction 和 --routines)

echo "[进行中] 正在 dumping MySQL 数据库..."

mysqldump -u$DB_USER --single-transaction --routines --triggers $DB_NAME > $DB_FILE

# 3. 混合打包网站文件与数据库压缩包

echo "[进行中] 正在将文件压入 tar.gz 高倍率包裹..."

tar -czvf $ARCHIVE_FILE $WEB_DIR $DB_FILE

# 4. 远程投递与传输到 Google Drive

echo "[进行中] 准备通过 Rclone 上传至云盘..."

rclone copy $ARCHIVE_FILE $RCLONE_REMOTE

# 5. 本地磁盘空间防爆:删除临时文件和过期旧文件(保留本地3天用于极速恢复)

echo "[清理] 清理服务器遗留尾巴痕迹..."

rm -f $DB_FILE

find $BACKUP_DIR -name "*.tar.gz" -type f -mtime +3 -exec rm {} \;

echo "[完成] 备份与上传生命周期结束!"保存并给予这个脚本极高执行权限:

chmod +x /root/scripts/auto_backup.sh建议你立马手动运行一次试试看:/root/scripts/auto_backup.sh,看着屏幕滚动无报错,然后再去你的 Google Drive 里查看是否有新文件。

4. crontab 定时按秒级触发,进入完全无人值守状态

执行命令:

crontab -e在文件最底下追加下面这一行(代表每天凌晨 3:30 这个网站访问量极度低洼的时间点开始执行备份):

30 3 * * * /root/scripts/auto_backup.sh > /root/scripts/backup.log 2>&1大功告成。这一套从零开始部署纯手工打造,绝对是最极致、最纯粹的做法,性能开销甚至不会让你的服务器产生多余的波动。

🖥️ 第二阶段:非技术站长建站向 —— 宝塔面板 (BT Panel) 一键化挂载

不是每个人都愿意去跟那个黑乎乎的命令行做斗争,如果你目前的服务器已经搭配了宝塔面板(或者 1Panel 面板),官方的免费/付费插件其实已经为你打通了网关,对新手极其友好。

第一步:在软件商店搜索认证插件

直接进入你的宝塔后台,在【软件商店】搜索“Google Drive”或者“OneDrive”。点击安装对应的官方认证备份插件。

第二步:傻瓜式浏览器级授权

插件安装完成后点击“设置”。得益于宝塔内置的 Web 浏览器代理封装,点击面板上的授权按钮,根据页面的跳转提示,登录你想要存放数据的 Google 账号,点击“允许”,Token 就会自动与你的宝塔服务器双向绑定。

第三步:添加极致严谨的计划任务

左侧菜单栏进入【计划任务】。这里才是体现 VPS 运营专家心血的地方:

- 任务类型: 选“备份数据库”或“备份网站”。建议你搞两个专门的独立任务。

- 执行周期: 设置为每天凌晨 4 点。这个时间点,就算是做外贸,欧美区也已经进入晚间流量最低谷。

- 备份到: 下拉菜单选择你刚刚授权好的 Google Drive 或 OneDrive!

- 保留最新: 切记填“7份”或“15份”!!! 千万别填 0 或留空。不设限额会导致日复一日的备份把你网盘塞爆,最终连网盘都无力回天而被暂停服务。

点击提交后,立刻手动点击一下任务列表里面的“执行”按钮。查看日志,看到“上传成功”等字眼,这套闭环就算是打通了。

🔄 后端回流战术 —— 遭遇灾难后如何进行抢救性恢复?

没有恢复方案的备份指南就是典型的“只管挖不管埋”。如果未来某天你的服务器崩溃了,你买了一台新机器,应该如何抢救?

如果你用的是 Rclone 方案:

你在新机器上重新配置好相同的 rclone config,紧接着并不是像上传那样麻烦,直接通过反向拉取命令拖回本地:

rclone copy gdrive:ServerBackup/full_web_backup_20261111.tar.gz /root/restore/拉取完毕后解压,并通过核心黑话指令强行导入数据库:

mysql -u root -p 你的新建立的空数据库名 < /root/restore/db_xxxx.sql如果你用的是宝塔面板方案:

同样去购买并装好全新宝塔面板后,装好同样的备份插件,再次挂起认证,然后在“备份管理”中直接点选对应日期的云端备份版本进行【恢复】。这种丝滑体验对于小白确实拥有更少的心理压力。

❓ 常见问题解答 (FAQ)

每天上传这么巨大的备份压缩包,会占用大量服务器带宽和 CPU 资源导致网站宕机吗?

这是一个非常硬核的问题。mysqldump 在打包或使用 tar 的过程中确实会引起 CPU 波峰飙高。如果是 1核 1G 的轻量服务器,建议在脚本中使用 nice -n 19 tar -czvf ... 把打包进程的系统优先级降到最低,让位给正常的 Web 用户请求。并且尽量把脚本定在凌晨执行,那时带宽基本上是完全闲置跑不满的。

我的网盘只有免费的 15GB,但是网站数据加起来已经 20GB 了,装不下怎么办?

这是纯物理层面打爆的困局。你有三种办法解决:第一,购买合租的世纪互联大容量 OneDrive 账号做替代;第二,修改上述 Rclone 脚本架构,把网站源文件庞大的媒体目录排除(增加 --exclude "wp-content/uploads/*" 参数),只备份纯净的数据库,因为核心资产通常都在文字和配置里;第三,多挂载几个 Google 账号写个分流脚本。

网盘备份会被谷歌官方视作滥用 API 或违规扫号吗?

只要你严格遵循定时快照原则(例如一天仅上传 1-2 次大型压缩包),绝不会被判定违规。官方 API 唯一深恶痛绝的做法,就是你无意义地在一秒钟内发送上百次细微小文件的频繁同步请求(这也是为什么我们强调一定要用 tar 整体打包)。按照规范操作,哪怕一直用下去也是绿灯通行的。

如果我是 Docker 容器部署的 MySQL,怎么执行在宿主机上的备份脚本?

你只需要稍微修改一行代码即可。不用直接在宿主机上触发 mysqldump,而是利用 docker 的 exec 层穿透执行:docker exec container_name mysqldump -uroot -ppassword database > backup.sql。(注:容器内执行同样建议使用 MYSQL_PWD 环境变量传参防泄露)。其余的打包和 Rclone 上传指令的链路结构完全不用变动。