Краткая выжимка: в 2026 году полагаться исключительно на «системные снапшоты» хостинг-провайдера — значит оставлять данные без защиты. Пожар в ЦОД, отказ диска или ошибка администратора могут мгновенно уничтожить ваш сайт. В этом руководстве мы детально разберём, как использовать бесплатное пространство Google Drive или OneDrive вместе с утилитой Rclone или плагинами панели управления, чтобы создать полностью автоматизированную, отказоустойчивую систему резервного копирования БД и файлов сайта на удалённый сервер. Инструкция охватывает механизмы обновления токенов, обход ограничений API, шифрование архивов, предотвращение блокировок таблиц и защиту паролей от утечки через процессы.

Честно говоря, в 2026 году запускать сервер без резервной копии или слепо надеяться на снапшоты VPS-провайдера — это огромный риск. Независимо от того, используете ли вы BandwagonHost, Spartan или RackNerd, отсутствие грамотного удалённого бэкапа превращает вашу работу в лотерею. Пожар в дата-центре, поломка накопителя, внезапное закрытие хостинга или одна неосторожная команда rm -rf /* способны за секунды стереть годы работы над WordPress-блогом или интернет-магазин DTC. Корпоративные решения для удалённого резервного копирования (например, AWS S3 или Alibaba Cloud OSS) надёжны, но для частных вебмастеров и владельцев интернет-магазинов они слишком сложны в настройке, а расходы на трафик и хранение данных быстро становятся неподъёмными.

На самом деле, вам не обязательно тратить деньги на резервное копирование. Используя свободное место в бесплатном Google Drive (15 ГБ) или OneDrive (1 ТБ по подписке Office 365 или через аккаунт E5), а также несколько строк автоматизированного скрипта или плагин панели управления, вы создадите бесплатную, полностью автономную и устойчивую систему хранения данных. После настройки эта схема работает по принципу «настроил один раз — забыл навсегда». Даже если сервер выйдет из строя, вы сможете полностью восстановлен за считанные минуты. Если вы всё ещё ищёте надёжный сервис бэкапов, это подробное практическое руководство поможет вам освоить ключевые правила выживания в экосистеме VPS.

В этой статье мы подробно разберём, как автоматически синхронизировать базы данных MySQL/MariaDB и исходные файлы сайта с Google Drive и OneDrive, используя разные методы (командную строку или графическую панель). Мы не только покажем пошаговые действия, но и разберём скрытые технические нюансы, чтобы гарантировать абсолютную сохранность ваших данных.

📊 Сравнение стратегий и методов резервного копирования в облачные диски

Прежде чем переходить к практике, рассмотрим доступные варианты. Таблица ниже наглядно показывает, сколько времени потребуется на освоение каждого метода и какой результат вы получите.

🔥 Сравнение популярных решений для бэкапа БД в облако: эксперты настоятельно рекомендуют Rclone

| Метод бэкапа | Сложность освоения | Поддержка безопасности и шифрования | Гибкость и планирование | Целевая аудитория |

|---|---|---|---|---|

| Rclone + скрипт Crontab | ⭐ Высокая (требуется знание Linux) | Поддержка продвинутого потокового шифрования, полная защита | Максимальная (настройка по секундам, любая структура) | Опытные администраторы / независимые VPS |

| Плагин облачного диска для cPanel/1Panel | ⭐ Низкая (графический интерфейс) | Требуется пароль для архива, уязвимо к перебору | Средняя, ограничена настройками версии панели | Вебмастера без глубоких технических знаний |

| UpdraftPlus (плагин WP) | Автоматическая привязка в один клик | Слабая (зависит от безопасности самого WP) | Только для конкретных директорий WordPress | Начинающие блогеры на WP |

Если вы запускаете лёгкий WP-блог или коммерческий сайт, хотите настроить всё один раз и полностью контролировать логику данных, забудьте о навороченных плагинах. Связка Rclone + автоматизированный скрипт — это безоговорочный лидер.

🧠 Разбор архитектуры и технические требования

Многие вебмастера уже пробовали использовать скрипты для прямой загрузки файлов в облако, но через несколько дней всё переставало работать. Здесь вступают в силу важные ограничения облачных платформ и правила работы API. Чтобы система работала стабильно, необходимо понимать базовую логику.

Авторизация OAuth 2.0 и механизм обновления токенов:

Когда вы разрешаете приложению (например, Rclone или плагину панели) доступ к Google Drive, сервис не сохраняет ваш логин и пароль, а выдаёт Access Token и Refresh Token. Access Token обычно действует всего несколько часов. Большинство ошибок при резервном копировании возникает из-за того, что утилита не умеет автоматически обновлять Refresh Token, что приводит к остановке процесса. Рекомендуемые нами Rclone и официальные плагины панелей имеют встроенный надёжный механизм автоматического обновления токенов.

Ограничения частоты запросов API (Rate Limits):

Никогда не пытайтесь синхронизировать тысячи мелких файлов сайта (изображения, кэш, фрагменты кода) напрямую в Google Drive или OneDrive! API облачных дисков строго ограничивает частоту запросов. Если выполнить команду синхронизации целой директории, ваш аккаунт получит блокировку API менее чем за полчаса из-за превышения лимитов.

Оптимальное решение: Сначала упакуйте файлы сайта и базу данных локально в один архив .tar.gz, а затем загружайте в облако только этот единый файл.

«Полный снапшот» против «инкрементального бэкапа БД»:

Не пытайтесь настраивать синхронизацию бинарных логов БД (Binlog) в реальном времени на бесплатных дисках. Это задача для профессиональных мультиоблачных архитектур. Наша стратегия: ежедневное создание полного архива-снапшота в ночное время по расписанию, именование файлов по дате и загрузка в облако. Старые данные автоматически удаляются по истечении срока. Простота и надёжность — для личных сайтов этого достаточно для достижения целевого времени восстановления (RTO).

💡 Рекомендации vps1111 по работе с бесплатными облачными дисками:

- Контроль лимита хранилища: Бесплатная версия Google Drive предоставляет только 15 ГБ. Рекомендуется использовать команду

findдля регулярного удаления архивов старше 7 или 15 дней. OneDrive E5 предлагает много места, но при низкой активности или использовании исключительно как холодного хранилища срабатывает система безопасности Microsoft: данные могут быть удалены, а аккаунт заблокирован. Обязательно настройте распределение данных по нескольким облакам. - Блокировка таблиц (Lock Table): При резервном копировании БД на высоконагруженном сайте выполнение

mysqldumpможет вызвать блокировку (сайт временно перестанет открываться). Обязательно добавляйте параметр--single-transactionв команду экспорта, чтобы избежать этой критической ошибки! - Максимальная конфиденциальность и защита от взлома: Если архив попадает в публичное облако, а пароль от диска будет скомпрометирован, конфиденциальные данные БД окажутся в открытом доступе. Настоятельно рекомендуется шифровать архивы с помощью

opensslили использовать надёжный пароль для ZIP-архивов!

🛠️ Этап 1: Выбор гик — автоматическая потоковая синхронизация через Rclone

Если у вас есть прямой доступ по SSH, вы используете стек LNMP или Docker без графических панелей, этот метод с Rclone даст вам полный контроль. Rclone часто называют «швейцарским ножом для облачных хранилищ» благодаря возможности управления API популярных дисков через командную строку.

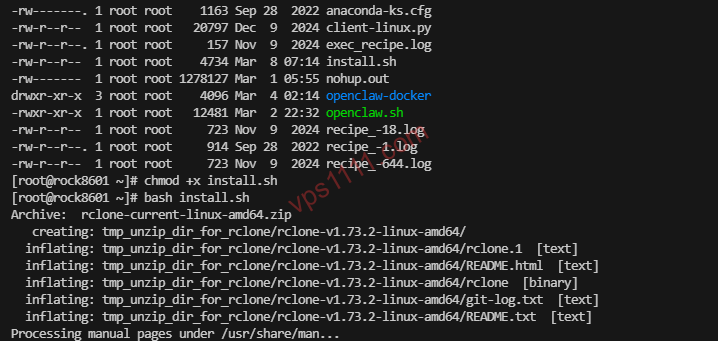

1. Установка ядра Rclone в один клик

Используйте официальный скрипт установки. Он демонстрирует крепкая стабильность как на Ubuntu, так и на CentOS. Просто выполните в SSH:

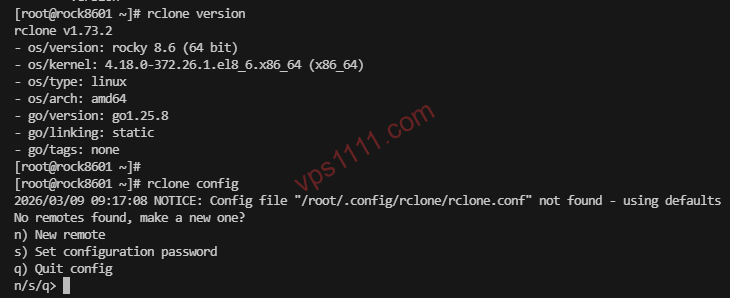

curl https://rclone.org/install.sh | sudo bashПосле установки введите rclone version, чтобы убедиться, что выводится номер версии.

2. Настройка авторизации для Google Drive или OneDrive

Здесь чаще всего возникают сложности у новичков: большинство наших VPS работают без графической оболочки (Headless-серверы), поэтому открыть браузер для авторизации напрямую невозможно. Нам потребуется выполнить настройку через локальный компьютер.

Краткий алгоритм:

Введите команду для запуска интерактивного меню:

rclone config- New remote: Введите имя нового подключения, например

gdriveилиonedrive. - Storage Type: Список будет длинным. Для Google Drive обычно выбирается соответствующий номер (около

18). Для OneDrive — обычно31(ориентируйтесь на актуальные подсказки в терминале). - Client ID / Client Secret: Просто нажмите Enter, чтобы пропустить и использовать публичный API Rclone. Для максимальной стабильности в будущем рекомендуется зарегистрировать собственные ключи в Google Cloud Console (для продвинутых пользователей).

- Scope: Выберите

1(полный доступ на чтение и запись). - Use auto config?: Система спросит, использовать ли автоматическую настройку. Важно: выберите

N(нет), так как на сервере нет браузера!

Далее система выдаст инструкцию:

For this to work, you will need rclone available on a machine that has a web browser available.

Это означает: вам нужно скачать локальную версию rclone на компьютер с графической оболочкой, открыть терминал (cmd) и ввести указанную команду: rclone authorize "drive" "xxxxxxxx".

На локальной машине откроется окно браузера. Войдите в свой аккаунт облачного диска, подтвердите доступ, и в терминале появится длинная строка с JSON-кодом токена.

Скопируйте этот код и вставьте его в терминал VPS на этапе ожидания авторизации, чтобы завершить подключение.

3. Создание автоматизированного скрипта: базовая логика Shell

Теперь, когда Rclone настроен, нужно указать серверу: «Что архивировать? Куда сохранять? Как отправить в облако?»

Создадим специальный скрипт в директории /root на VPS:

mkdir -p /root/scripts

mkdir -p /root/backup_temp

nano /root/scripts/auto_backup.shСкопируйте приведённый ниже код, заменив данные на свои, и вставьте его в файл. (Обратите внимание: здесь используется передача пароля через переменные окружения для повышения безопасности, что исключает риск утечки пароля БД через команду ps):

#!/bin/bash

# ==========================================

# Автоматическое резервное копирование БД и файлов сайта в Google Drive

# ==========================================

# 1. Блок переменных (замените на свои данные)

DB_USER="root"

# Стандарт безопасности: передача пароля через переменную окружения для защиты от ps -ef и подавления предупреждений

export MYSQL_PWD="ваш_пароль_от_бд"

DB_NAME="имя_вашей_бд"

# Для бэкапа файлов сайта укажите полный путь

WEB_DIR="/var/www/html"

# Имя подключения Rclone и путь в облаке

RCLONE_REMOTE="gdrive:ServerBackup"

# Временная директория (должна быть создана заранее)

BACKUP_DIR="/root/backup_temp"

# Генерация метки даты и времени

DATE=$(date +"%Y%m%d_%H%M%S")

DB_FILE="$BACKUP_DIR/db_$DB_NAME_$DATE.sql"

ARCHIVE_FILE="$BACKUP_DIR/full_web_backup_$DATE.tar.gz"

echo "[Старт] $(date) - Запуск процесса защищённого резервного копирования"

# 2. Экспорт БД (важно: добавлены --single-transaction и --routines)

echo "[В процессе] Выполняется дамп базы данных MySQL..."

mysqldump -u$DB_USER --single-transaction --routines --triggers $DB_NAME > $DB_FILE

# 3. Архивация файлов сайта и дампа БД

echo "[В процессе] Упаковка файлов в архив tar.gz..."

tar -czvf $ARCHIVE_FILE $WEB_DIR $DB_FILE

# 4. Загрузка в облачное хранилище через Rclone

echo "[В процессе] Подготовка к загрузке в облако через Rclone..."

rclone copy $ARCHIVE_FILE $RCLONE_REMOTE

# 5. Очистка локального диска: удаление временных и старых файлов (хранение локально 3 дня для быстрого восстановления)

echo "[Очистка] Удаление временных файлов на сервере..."

rm -f $DB_FILE

find $BACKUP_DIR -name "*.tar.gz" -type f -mtime +3 -exec rm {} \;

echo "[Завершено] Цикл резервного копирования и загрузки успешно выполнен!"Сохраните файл и назначьте ему права на выполнение:

chmod +x /root/scripts/auto_backup.shРекомендуем сразу запустить его вручную для проверки: /root/scripts/auto_backup.sh. Если в терминале не появится ошибок, проверьте Google Drive на наличие нового файла.

4. Настройка crontab для полностью автономной работы

Выполните команду:

crontab -eВ конец файла добавьте следующую строку (запуск ежедневно в 03:30, когда трафик на сайте минимален):

30 3 * * * /root/scripts/auto_backup.sh > /root/scripts/backup.log 2>&1Готово. Эта полностью ручная настройка с нуля является самым эффективным и чистым решением. Нагрузка на сервер будет минимальной и не повлияет на работу сайта.

🖥️ Этап 2: Для вебмастеров без глубоких знаний — автоматическое подключение через cPanel

Не все готовы разбираться с командной строкой. Если на вашем сервере уже установлена панель управления cPanel (или 1Panel), официальные бесплатные или платные плагины уже предоставляют готовый шлюз, что максимально упрощает процесс для новичков.

Шаг 1: Поиск и установка плагина

Зайдите в админ-панель cPanel, перейдите в раздел «Магазин приложений» (Software Store) и найдите «Google Drive» или «OneDrive». Установите официальный плагин для резервного копирования.

Шаг 2: Авторизация через браузер

После установки нажмите «Настройки». Благодаря встроенному веб-прокси панели, достаточно нажать кнопку авторизации, следовать инструкциям на странице, войти в аккаунт Google для хранения данных и нажать «Разрешить». Токен автоматически свяжется с вашим сервером.

Шаг 3: Настройка строгого расписания задач

В левом меню перейдите в раздел «Планировщик задач» (Cron). Именно здесь закладывается основа надёжной работы:

- Тип задачи: Выберите «Резервное копирование БД» или «Резервное копирование сайта». Рекомендуется создать две отдельные задачи.

- Периодичность: Установите ежедневный запуск в 04:00. В это время трафик из Европы и США находится на минимуме.

- Куда сохранять: В выпадающем списке выберите только что подключённый Google Drive или OneDrive!

- Хранить: Обязательно укажите «7 копий» или «15 копий»!!! Не оставляйте поле пустым или со значением 0. Без лимита ежедневные бэкапы быстро заполнят облачный диск, что приведёт к остановке синхронизации.

После сохранения сразу нажмите кнопку «Выполнить» в списке задач. Проверьте журнал: если увидите статус «Загрузка завершена успешно», система полностью готова к работе.

🔄 Стратегия восстановления — как вернуть данные после сбоя?

Инструкция по бэкапу без описания восстановления бесполезна. Если ваш сервер выйдет из строя и вы купите новый, как быстро вернуть данные?

При использовании Rclone:

На новом сервере выполните ту же настройку rclone config. Вместо загрузки используйте команду обратного скачивания:

rclone copy gdrive:ServerBackup/full_web_backup_20261111.tar.gz /root/restore/После скачивания распакуйте архив и импортируйте базу данных с помощью стандартной команды:

mysql -u root -p имя_новой_пустой_бд При использовании cPanel:

Установите панель и тот же плагин бэкапа на новом сервере, повторно авторизуйтесь, затем в разделе «Управление резервными копиями» просто выберите нужную дату и нажмите «Восстановить». Такой интерфейс значительно снижает стресс для начинающих пользователей.

❓ Часто задаваемые вопросы (FAQ)

Будет ли загрузка больших архивов ежедневно перегружать канал и CPU сервера, вызывая падение сайта?

Это важный технический вопрос. Процесс mysqldump или упаковка через tar действительно вызывает кратковременный скачок нагрузки на процессор. Если у вас сервер с конфигурацией 1 ядро / 1 ГБ ОЗУ, рекомендуется добавить в скрипт nice -n 19 tar -czvf ..., чтобы снизить приоритет процесса архивации и отдать ресурсы веб-запросам. Кроме того, запуск скрипта в ночное время гарантирует, что канал связи будет практически свободен.

У меня бесплатный лимит 15 ГБ, а данные сайта весят уже 20 ГБ. Как быть?

Это ограничение физического хранилища. Есть три решения: во-первых, приобрести доступ к корпоративному OneDrive с большим объёмом; во-вторых, изменить скрипт Rclone, исключив тяжёлую директорию медиафайлов (добавив параметр --exclude "wp-content/uploads/*"), и бэкапить только чистую базу данных, так как основная ценность обычно заключается в текстах и настройках; в-третьих, подключить несколько аккаунтов Google и настроить скрипт распределения нагрузки.

Расценит ли Google резервное копирование как злоупотребление API или нарушение правил?

Если вы строго соблюдаете график создания снапшотов (например, загрузка 1–2 больших архивов в день), нарушений не будет. API блокирует только бессмысленную отправку сотен мелких файлов в секунду (именно поэтому мы настаиваем на упаковке в tar). При соблюдении правил использование сервиса будет полностью безопасным.

Как запускать скрипт бэкапа на хост-машине, если MySQL работает в Docker-контейнере?

Достаточно изменить одну строку. Вместо прямого вызова mysqldump на хосте используйте команду выполнения внутри контейнера: docker exec container_name mysqldump -uroot -ppassword database > backup.sql. (Примечание: внутри контейнера также рекомендуется передавать пароль через переменную окружения MYSQL_PWD для безопасности). Остальная логика упаковки и загрузки через Rclone остаётся без изменений.