Kernaussage: Im Jahr 2026 ist die alleinige Abhängigkeit von den „System-Snapshots“ deines VPS-Anbieters gleichbedeutend damit, deine Daten ungeschützt zu lassen. Ein Rechenzentrumsbrand, ein Festplattenausfall oder eine Fehlbedienung können deine Website jederzeit vernichten. Dieser Artikel zeigt detailliert auf, wie du mit kostenlosem Speicherplatz von Google Drive oder OneDrive, kombiniert mit der Rclone-CLI oder einem Plesk-Plugin, ein kostenloses, vollautomatisches und robustes Offsite-Backup-System für Datenbanken und Website-Quelldateien aufbaust. Das Tutorial deckt zentrale Fallstricke ab, darunter Token-Erneuerungsmechanismen, die Vermeidung von API-Sperren, die verschlüsselte Archivierung einzelner Dateien, die Vermeidung von Datenbank-Sperren (Locks) und den Schutz vor Passwort-Leaks in Prozessen.

Ganz ehrlich: Wer im Jahr 2026 seinen Server immer noch ohne Backup betreibt oder sich blind auf die „System-Snapshots“ des VPS-Anbieters verlässt, spielt ein gefährliches Spiel. Egal ob du BandwagonHost, Spartan oder RackNerd nutzt – ohne ein solides Offsite-Backup setzt du dein Projekt rein auf Glück. Ein Rechenzentrumsbrand, ein Festplattencrash, ein unerwarteter Ausfall des Anbieters oder ein versehentliches rm -rf /* können die Daten deines über Jahre gepflegten WordPress-Blogs oder deiner DTC-E-Commerce-Website in Sekunden vernichten. Enterprise-Lösungen wie AWS S3 oder Alibaba Cloud OSS sind zwar stabil, aber für private Webmaster und E-Commerce-Betreiber oft zu komplex in der Konfiguration und durch Bandbreiten- sowie Speicherkosten unnötig teuer.

Tatsächlich musst du für Backups kein Geld ausgeben. Mit deinem ungenutzten kostenlosen Google Drive (15 GB) oder OneDrive (1 TB via Office 365 oder E5-Entwicklerkonto) sowie ein paar einfachen Automatisierungsskripten oder einem Panel-Plugin erstellst du ein kostenloses, vollautomatisches und ausfallsicheres Offsite-Backup. Nach der Konfiguration läuft es nach dem Prinzip „Einmal einrichten, dauerhaft profitieren“. Selbst bei einem kompletten Serverausfall kannst du innerhalb weniger Minuten vollständig wiederhergestellt sein. Wenn du noch nach einer zuverlässigen Backup-Lösung suchst, wird dieser umfassende, schrittweise Praxis-Guide dir die essenziellen Überlebensregeln im VPS-Umfeld vermitteln.

In diesem Artikel analysieren wir detailliert, wie du MySQL/MariaDB-Datenbanken und Website-Quelldateien deines Servers vollautomatisch über verschiedene Methoden (CLI oder Panel) mit Google Drive und OneDrive synchronisierst. Neben den konkreten Schritten klären wir auch technische Fachbegriffe und typische Fehlerquellen, um die absolute Sicherheit deiner Daten zu gewährleisten.

📊 Vergleich der gängigen Cloud-Backup-Strategien und -Lösungen

Bevor du mit der praktischen Umsetzung beginnst, verschaff dir einen Überblick über die aktuell verfügbaren Methoden. Die folgende Tabelle zeigt, welche Lernkurve und Ergebnisse die drei Ansätze bieten.

🔥 Vergleich der Cloud-Datenbank-Backup-Lösungen: Experten empfehlen Rclone

| Backup-Lösung | Lernaufwand | Sicherheit & Verschlüsselung | Flexibilität & Scheduling | Zielgruppe |

|---|---|---|---|---|

| Rclone + Crontab-Skript | ⭐ Hoch (Linux-Kenntnisse erforderlich) | Unterstützt erweiterte Stream-Verschlüsselung, lückenlos | Sehr hoch (sekundengenaue Anpassung, strukturunabhängig) | Technik-Enthusiasten / Dedizierte VPS |

| Plesk / 1Panel Cloud-Plugin | ⭐ Niedrig (Grafische Oberfläche) | Erfordert Archiv-Passwort, anfällig für Brute-Force | Mittel, abhängig von der Panel-Version | Webmaster ohne tiefes Technikwissen |

| UpdraftPlus (WP-Plugin) | Einfache Ein-Klick-Verbindung | Schwächer (abhängig von WP-Sicherheit) | Nur auf bestimmte WordPress-Verzeichnisse beschränkt | Reine WordPress-Blogger (Anfänger) |

Wenn du einen leichten bis mittelschweren WordPress-Blog oder eine DTC-E-Commerce-Website betreibst und eine dauerhafte Lösung mit voller Kontrolle über die Datenlogik suchst, ist die Kombination aus Rclone + Automatisierungsskript die überlegene Wahl. Vergiss unnötige Plugins.

🧠 Technische Grundlagen und Voraussetzungen

Viele Webmaster haben bereits Skripte getestet, die Dateien direkt in Cloud-Speicher hochladen, die jedoch oft nach wenigen Tagen versagten. Dies hängt mit mehreren entscheidenden Cloud-Computing-Mechanismen und Regeln zusammen. Für einen stabilen Betrieb ist das Verständnis der zugrundeliegenden Logik unerlässlich.

OAuth 2.0-Autorisierung und Token-Erneuerungsmechanismus:

Wenn du einer Anwendung (z. B. Rclone oder einem Plesk-Plugin) den Zugriff auf dein Google Drive gewährst, speichert der Cloud-Dienst nicht dein Passwort, sondern vergibt ein Access Token und ein Refresh Token. Access Tokens sind meist nur wenige Stunden gültig. Viele Backup-Fehler bei Anfängern entstehen, weil das Tool das Refresh Token nicht automatisch verarbeitet. Die von uns empfohlenen Lösungen wie Rclone und offizielle Panel-Plugins verfügen über robuste, integrierte Token-Erneuerungsfunktionen.

API-Ratenbegrenzung (Rate Limits):

Synchronisiere niemals Tausende winziger Dateien (Bilder, Cache-Fragmente, Code) direkt mit Google Drive oder OneDrive! Cloud-APIs unterliegen strengen Häufigkeitsbegrenzungen. Ein direkter Sync eines gesamten Verzeichnisses führt innerhalb von Minuten zu einer Rate-Limit-Sperre und blockiert den API-Zugriff.

Optimale Lösung: Packe Website-Dateien und Datenbank lokal zunächst in eine einzelne .tar.gz-Archivdatei und lade nur diese einzelne Datei hoch.

„Vollständige Snapshots“ vs. „Datenbank-Inkremente“:

Versuche nicht, Echtzeit-Inkrement-Synchronisationen von Datenbank-Binlogs auf kostenlosen Cloud-Speichern durchzuführen. Dies ist professionellen Multi-Cloud-Architekturen vorbehalten. Unser Ansatz: Ein tägliches nächtliches „Voll-Backup“ per Cronjob, datiert benannt und in die Cloud verschoben. Alte Backups werden nach einer festgelegten Frist automatisch gelöscht. Einfachheit ist hier der Schlüssel und für die RTO (Recovery Time Objective) privater Websites völlig ausreichend.

💡 vps1111 Leitfaden zur Fehlervermeidung (Risiken bei kostenlosen Cloud-Speichern):

- Speicherlimit-Warnung: Die kostenlose Google Drive-Version bietet nur 15 GB. Nutze den

find-Befehl, um Backups älter als 7 oder 15 Tage regelmäßig zu löschen. OneDrive E5 bietet zwar viel Speicher, aber bei geringer Nutzung oder reiner Kaltlagerung kann Microsoft das Konto aus Sicherheitsgründen sperren und Daten löschen. Implementiere daher eine Multi-Cloud-Strategie. - Datenbank-Sperren (Locks) vermeiden: Bei hochfrequenten Websites kann die Ausführung von

mysqldumpzu Deadlocks führen, wodurch die Website während des Backups kurzzeitig nicht erreichbar ist. Füge dem Export-Befehl zwingend den Parameter--single-transactionhinzu, um dieses kritische Problem zu umgehen! - Datenschutz und Schutz vor unbefugtem Zugriff: Sobald das Backup in der Public Cloud liegt, sind bei einem kompromittierten Cloud-Passwort sensible Datenbankdaten vollständig exponiert. Wir empfehlen dringend, das Archiv mit

opensslzu verschlüsseln oder ein starkes ZIP-Passwort zu verwenden!

🛠️ Phase 1: Die Wahl für Technik-Enthusiasten – Rclone-Integration und vollautomatische Stream-Synchronisation

Wenn du direkten SSH-Zugriff hast, LNMP oder Docker nutzt und auf ein Kontrollpanel verzichtest, bietet dir Rclone maximale Freiheit. Als „Schweizer Taschenmesser für Cloud-Speicher“ ermöglicht es die API-Anbindung gängiger Cloud-Dienste direkt über die Kommandozeile.

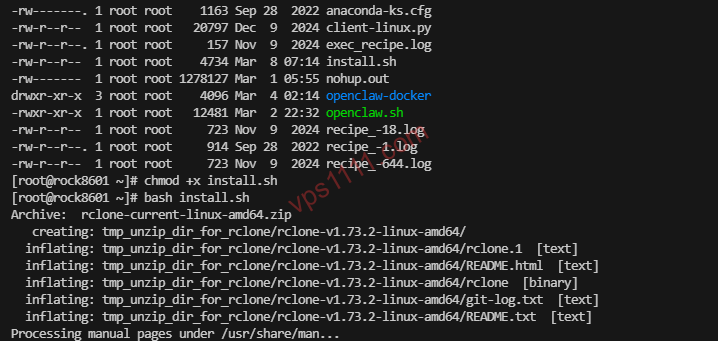

1. Rclone-Kernkomponenten per Ein-Klick-Skript installieren

Nutze das offizielle Installationsskript. Es funktioniert unter Ubuntu und CentOS gleichermaßen Extrem stabil. Führe es direkt per SSH aus:

curl https://rclone.org/install.sh | sudo bashNach der Installation prüfe mit rclone version, ob die Versionsnummer korrekt ausgegeben wird.

2. Google Drive oder OneDrive autorisieren und konfigurieren

Dies ist der häufigste Stolperstein für Anfänger: Da die meisten VPS-Server keine grafische Oberfläche besitzen (Headless-Server), kannst du keinen Browser zur Autorisierung öffnen. Daher nutzen wir deinen lokalen PC als Brücke.

Ablauf:

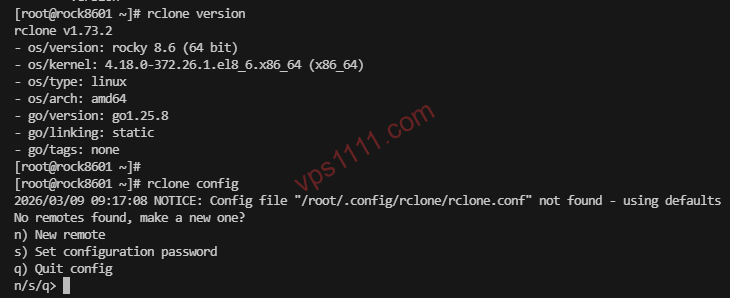

Gib folgenden Befehl ein, um das interaktive Menü zu starten:

rclone config- New remote: Gib einen neuen Verbindungsnamen ein, z. B.

gdriveoderonedrive. - Storage Type: Die Liste ist lang. Für Google Drive wählst du die entsprechende Nummer (meist

18). Für OneDrive ist es typischerweise31(bitte beachte die aktuelle Prompt-Ausgabe). - Client ID / Client Secret: Drücke Enter, um die Standard-Rclone-API zu nutzen. Für maximale Stabilität empfehlen wir jedoch, später eigene API-Schlüssel über die Google Cloud Console zu erstellen (Fortgeschritten).

- Scope: Wähle

1(Vollständiger Lese-/Schreibzugriff). - Use auto config?: Das System fragt nach der automatischen Konfiguration. Wichtig: Wähle

N(Nein), da kein Browser verfügbar ist!

Das System zeigt dir anschließend folgende Anleitung an:

For this to work, you will need rclone available on a machine that has a web browser available.

Das bedeutet: Du musst auf einem lokalen Rechner mit Desktop-Betriebssystem (z. B. deinem PC) eine lokale Rclone-Version herunterladen und den angezeigten Befehl in der CMD/Terminal eingeben: rclone authorize "drive" "xxxxxxxx".

Anschließend öffnet sich auf deinem lokalen Rechner ein Browserfenster. Nach der Anmeldung und Bestätigung der Berechtigungen gibt die Kommandozeile einen langen, entscheidenden Token-JSON-String aus.

Kopiere diesen Code und füge ihn in das wartende VPS-Terminal ein, um die Verbindung abzuschließen.

3. Das Herzstück der Automatisierung: Das zentrale Shell-Skript

Mit der Rclone-Umgebung müssen wir dem Server nun mitteilen, was gepackt, wo gespeichert und wie in die Cloud übertragen wird.

Erstelle ein dediziertes Skript im /root-Verzeichnis deines VPS:

mkdir -p /root/scripts

mkdir -p /root/backup_temp

nano /root/scripts/auto_backup.shKopiere den folgenden optimierten Code, passe deine Daten an und füge ihn ein. (Hinweis: Passwörter werden hier sicher über Umgebungsvariablen übergeben, um ein Auslesen durch ps-Prozesse zu verhindern):

#!/bin/bash

# ==========================================

# Automatisches Datenbank- und Website-Backup zu Google Drive

# ==========================================

# 1. Variablendefinition (Ersetze diese mit deinen eigenen Daten)

DB_USER="root"

# Sicherheitsstandard: Passwort via Umgebungsvariable übergeben, um Abfangen durch ps -ef zu verhindern und Warnungen zu vermeiden

export MYSQL_PWD="Dein_Datenbank_Passwort"

DB_NAME="Dein_Datenbankname"

# Für Website-Dateien: Gib den vollständigen Pfad ein

WEB_DIR="/var/www/html"

# Rclone-Remote-Name und Cloud-Speicherpfad

RCLONE_REMOTE="gdrive:ServerBackup"

# Temporäres Verzeichnis (muss vorher erstellt werden)

BACKUP_DIR="/root/backup_temp"

# Zeitstempel generieren

DATE=$(date +"%Y%m%d_%H%M%S")

DB_FILE="$BACKUP_DIR/db_$DB_NAME_$DATE.sql"

ARCHIVE_FILE="$BACKUP_DIR/full_web_backup_$DATE.tar.gz"

echo "[Start] $(date) - Backup-Prozess wird initiiert"

# 2. Datenbank exportieren (Wichtig: --single-transaction und --routines hinzufügen)

echo "[Fortschritt] MySQL-Datenbank wird exportiert..."

mysqldump -u$DB_USER --single-transaction --routines --triggers $DB_NAME > $DB_FILE

# 3. Website-Dateien und Datenbank in ein Archiv packen

echo "[Fortschritt] Dateien werden in tar.gz komprimiert..."

tar -czvf $ARCHIVE_FILE $WEB_DIR $DB_FILE

# 4. Upload zu Google Drive via Rclone

echo "[Fortschritt] Upload zur Cloud wird vorbereitet..."

rclone copy $ARCHIVE_FILE $RCLONE_REMOTE

# 5. Lokalen Speicher bereinigen: Temporäre und alte Dateien löschen (3 Tage lokal behalten für schnelle Wiederherstellung)

echo "[Bereinigung] Alte Spuren auf dem Server werden entfernt..."

rm -f $DB_FILE

find $BACKUP_DIR -name "*.tar.gz" -type f -mtime +3 -exec rm {} \;

echo "[Fertig] Backup- und Upload-Zyklus abgeschlossen!"Speichere die Datei und vergebe die Ausführungsberechtigung:

chmod +x /root/scripts/auto_backup.shTeste das Skript sofort manuell: /root/scripts/auto_backup.sh. Wenn die Ausgabe fehlerfrei durchläuft, prüfe dein Google Drive auf die neue Datei.

4. Automatisierung via Crontab für den vollständig unbeaufsichtigten Betrieb

Führe folgenden Befehl aus:

crontab -eFüge am Ende der Datei folgende Zeile hinzu (startet das Backup täglich um 03:30 Uhr, wenn der Website-Traffic am niedrigsten ist):

30 3 * * * /root/scripts/auto_backup.sh > /root/scripts/backup.log 2>&1Damit ist die Einrichtung abgeschlossen. Diese manuell von Grund auf aufgebaute Lösung ist äußerst effizient und verursacht kaum messbare Performance-Einbußen auf deinem Server.

🖥️ Phase 2: Für Webmaster ohne CLI-Kenntnisse – Ein-Klick-Integration mit Plesk

Nicht jeder möchte sich mit der Kommandozeile auseinandersetzen. Wenn dein Server bereits mit Plesk (oder 1Panel) läuft, haben die offiziellen kostenlosen oder kostenpflichtigen Plugins die Integration bereits vereinfacht und sind besonders anfängerfreundlich.

Schritt 1: Offizielles Plugin im Software-Store suchen

Öffne dein Plesk-Backend und suche im [Software-Store] nach „Google Drive“ oder „OneDrive“. Installiere das entsprechende offiziell zertifizierte Backup-Plugin.

Schritt 2: Einfache Browser-Autorisierung

Nach der Installation klicke auf „Einstellungen“. Dank der integrierten Web-Proxy-Funktion von Plesk kannst du direkt auf die Autorisierungsschaltfläche klicken. Folge den Weiterleitungen, melde dich bei deinem Google-Konto an, klicke auf „Zulassen“, und das Token wird automatisch mit deinem Server verknüpft.

Schritt 3: Präzise Cronjobs einrichten

Navigiere im linken Menü zu [Geplante Aufgaben]. Hier zeigt sich die Expertise im VPS-Betrieb:

- Aufgabentyp: Wähle „Datenbank-Backup“ oder „Website-Backup“. Wir empfehlen zwei separate Aufgaben.

- Ausführungszeit: Stelle täglich 04:00 Uhr ein. Zu diesem Zeitpunkt ist der Traffic aus Europa und Nordamerika typischerweise am niedrigsten.

- Backup-Ziel: Wähle im Dropdown-Menü dein soeben autorisiertes Google Drive oder OneDrive!

- Neueste behalten: Unbedingt „7“ oder „15“ eintragen!!! Lasse den Wert niemals auf 0 oder leer. Ohne Limit füllen sich die Cloud-Speicher täglich, bis der Dienst aufgrund von Überlastung oder Richtlinienverstößen gesperrt wird.

Nach dem Speichern klicke sofort auf „Ausführen“ in der Aufgabenliste. Prüfe das Protokoll: Sobald „Upload erfolgreich“ erscheint, ist der Kreislauf vollständig eingerichtet.

🔄 Disaster-Recovery-Strategie – Wie stellst du deine Daten nach einem Ausfall wieder her?

Ein Backup-Guide ohne Wiederherstellungsanleitung ist unvollständig. Falls dein Server eines Tages ausfällt und du eine neue Maschine einrichtest, wie gehst du vor?

Bei Nutzung von Rclone:

Konfiguriere auf der neuen Maschine erneut rclone config. Anstatt hochzuladen, ziehst du die Daten einfach per Reverse-Sync zurück:

rclone copy gdrive:ServerBackup/full_web_backup_20261111.tar.gz /root/restore/Nach dem Download entpacke das Archiv und importiere die Datenbank mit folgendem Befehl:

mysql -u root -p Dein_Neuer_Datenbankname < /root/restore/db_xxxx.sqlBei Nutzung von Plesk:

Installiere nach dem Serverwechsel erneut Plesk und das Backup-Plugin, autorisiere es erneut und wähle in der „Backup-Verwaltung“ einfach die gewünschte Cloud-Version für die [Wiederherstellung] aus. Dieser reibungslose Ablauf ist besonders für Anfänger stressfrei.

❓ Häufig gestellte Fragen (FAQ)

Wird das tägliche Hochladen großer Backup-Archive die Serverbandbreite und CPU so stark belasten, dass die Website ausfällt?

Dies ist eine wichtige Frage. mysqldump und tar können tatsächlich kurzzeitige CPU-Spitzen verursachen. Bei einem 1-Core/1-GB-Server empfehlen wir, im Skript nice -n 19 tar -czvf ... zu verwenden, um die Prozesspriorität zu minimieren und Ressourcen für reguläre Webanfragen freizuhalten. Zudem sollte das Skript nachts ausgeführt werden, wenn die Bandbreite ohnehin kaum ausgelastet ist.

Mein Cloud-Speicher bietet nur 15 GB, aber meine Website-Daten umfassen bereits 20 GB. Was tun?

Dies ist ein klassisches Speicherlimit-Problem. Du hast drei Optionen: Erstens, ein geteiltes OneDrive-Konto mit großem Speicher nutzen. Zweitens, das Rclone-Skript anpassen und große Medienverzeichnisse ausschließen (Parameter --exclude "wp-content/uploads/*" hinzufügen), um nur die reine Datenbank zu sichern, da sich die Kernwerte meist in Texten und Konfigurationen befinden. Drittens, mehrere Google-Konten einbinden und ein Lastverteilungsskript schreiben.

Kann Google das Cloud-Backup als API-Missbrauch oder verdächtiges Verhalten einstufen?

Solange du dich strikt an den Zeitplan hältst (z. B. nur 1–2 große Archive pro Tag hochladen), wird dies nicht als Verstoß gewertet. Die offizielle API blockiert ausschließlich das sinnlose Senden von Hunderten kleiner Dateien pro Sekunde (daher die Empfehlung, alles mit tar zu packen). Bei korrekter Anwendung läuft der Prozess dauerhaft stabil.

Wie führe ich das Backup-Skript auf dem Host aus, wenn MySQL in einem Docker-Container läuft?

Du musst nur eine Zeile anpassen. Statt mysqldump direkt auf dem Host auszuführen, nutze den Docker-Exec-Befehl: docker exec container_name mysqldump -uroot -ppassword database > backup.sql. (Hinweis: Auch hier empfiehlt sich die Übergabe des Passworts via MYSQL_PWD-Umgebungsvariable). Der Rest des Skripts für das Packen und den Rclone-Upload bleibt unverändert.