핵심 요약: 2026년 현재, VPS 업체의 ‘시스템 스냅샷’에만 의존하는 것은 데이터를 ‘무방비’ 상태로 방치하는 것과 같습니다. 데이터센터 화재, 디스크 고장 또는 관리자의 조작 실수로 인해 사이트가 순식간에 사라질 수 있습니다. 본 가이드에서는 무료 Google Drive 또는 OneDrive 공간을 활용하고, Rclone 명령어나 관리 패널 플러그인과 결합하여 비용 없이 완전 자동화된 강력한 오프사이트(원격지) 데이터베이스 및 웹사이트 파일 백업 시스템을 구축하는 방법을 아키텍트 수준으로 상세히 다룹니다. 토큰 갱신 메커니즘, API 차단 회피, 단일 파일 암호화 압축, 테이블 락 방지 및 프로세스 암호 유출 방지 등 핵심적인 트러블슈팅 가이드를 모두 포함합니다.

솔직히 말해, 2026년에도 여전히 서버를 백업 없이 운영하거나 VPS 제공업체의 ‘시스템 스냅샷’에만 맹목적으로 의존하고 있다면, 그것은 정말 위험한 도박입니다. BandwagonHost, Spartan, RackNerd 등 어떤 업체를 사용하든, 제대로 된 원격지 재해 복구(DR) 대책을 마련하지 않았다면 운에 의존하고 있는 셈입니다. 데이터센터 화재, 하드웨어 손상, 호스팅 업체의 돌발적인 폐업, 혹은 rm -rf /* 명령어 한 번의 실수로 수년간 정성껏 운영해 온 WordPress 블로그나 비즈니스 웹사이트 데이터가 한순간에 잿더미로 변할 수 있습니다. AWS S3나 Alibaba Cloud OSS 같은 기업용 원격 백업은 견고하지만, 개인 웹마스터나 소규모 운영자에게는 설정이 복잡할 뿐만 아니라 트래픽 및 스토리지 종량제 요금도 무시할 수 없는 부담이 됩니다.

사실, 백업에 큰돈을 쓸 필요는 없습니다. 사용하지 않는 무료 Google Drive(15GB 무료 공간)나 OneDrive(Office 365 제공 1TB 또는 E5 무료 계정)를 활용하고, 몇 줄의 자동화 스크립트나 관리 패널 플러그인을 더하기만 하면 제로 비용으로 완전 자동화된 강력한 원격 데이터 대피소를 구축할 수 있습니다. 이 시스템은 한 번 설정해 두면 ‘평생’ 혜택을 누릴 수 있으며, 서버가 완전히 붕괴되더라도 수십 분 내에 완벽하게 복구할 수 있습니다. 아직도 믿을 만한 백업 서비스를 찾고 있다면, 이 상세한 실전 가이드가 VPS 생태계에서의 핵심 생존 법칙을 마스터하는 데 도움을 줄 것입니다.

이 글에서는 서버의 MySQL/MariaDB 데이터베이스와 웹사이트 소스 파일을 다양한 방식(커맨드 라인 또는 패널 환경)을 통해 Google Drive 및 OneDrive로 완전 자동 동기화하는 방법을 심층 분석합니다. 단순한 조작 단계를 넘어, 클라우드 업계의 ‘전문 용어’와 흔히 겪는 함정까지 짚어주어 데이터의 안전을 100% 보장합니다.

📊 주요 클라우드 스토리지 백업 전략 및 솔루션 비교

실전에 들어가기 전에 현재 사용 가능한 방법들을 살펴보겠습니다. 아래의 비교 표를 통해 투자해야 할 학습 비용과 예상되는 결과를 확인해 보세요.

🔥 주요 클라우드 데이터베이스 백업 솔루션 PK (전문가는 Rclone을 강력히 추천합니다)

| 백업 솔루션 | 학습 비용 | 보안 및 암호화 지원 | 유연성 및 스케줄링 | 주요 대상 사용자 |

|---|---|---|---|---|

| Rclone + Crontab 스크립트 | ⭐높음 (Linux 지식 필요) | 고급 스트림 암호화 지원, 사각지대 없음 | 매우 높음 (초 단위 맞춤 설정, 구조 제한 없음) | 파워 유저 / 단독 VPS 운영자 |

| 관리 패널 (aaPanel/1Panel 등) 플러그인 | ⭐낮음 (GUI 환경) | 압축 파일 암호에 의존, 뚫리기 쉬움 | 보통, 패널 버전에 제한됨 | 비기술직 사이트 운영자 |

| UpdraftPlus (WP 전용 플러그인) | 원클릭 연동으로 간편함 | 약함 (WP 자체 보안에 의존) | WordPress 특정 디렉터리로 제한 | 순수 WP 블로거 (초보자) |

중소규모 WP 블로그나 비즈니스 사이트를 운영 중이고, 한 번의 설정으로 모든 기본 데이터 로직을 통제하며 영구적으로 사용하고 싶다면 화려한 플러그인은 버리십시오. Rclone + 자동화 스크립트 조합이 ‘최강’의 선택입니다.

🧠 핵심 원리 분석 및 사전 기술 설명

과거에 스크립트를 사용해 클라우드 스토리지로 직접 동기화하려다 며칠 만에 중단된 경험이 있으신가요? 안정적으로 운영하려면 클라우드 컴퓨팅의 중요한 규칙과 백엔드 로직을 이해해야 합니다.

OAuth 2.0 인증 및 토큰 갱신 메커니즘:

Rclone이나 패널 플러그인 같은 애플리케이션이 Google Drive에 액세스할 때, 클라우드는 비밀번호를 직접 저장하지 않고 ‘Access Token’과 ‘Refresh Token’을 발급합니다. Access Token의 수명은 보통 몇 시간 정도입니다. 초보자의 백업이 실패하는 가장 큰 이유는 툴이 Refresh Token을 자동으로 갱신하지 못해 데드락(교착 상태)에 빠지기 때문입니다. 추천해 드리는 Rclone과 정식 패널 플러그인의 핵심 장점은 매우 견고한 토큰 자동 갱신 기능을 갖추고 있다는 것입니다.

API 요청 제한 (Rate Limits):

사이트 내의 수만 개의 작은 파일(이미지, 캐시 조각 코드 등)을 Google Drive나 OneDrive로 직접 동기화하지 마십시오! 클라우드 API에는 엄격한 요청 빈도 제한이 있습니다. 디렉터리 전체를 직접 동기화하는 명령을 실행하면, 30분도 채 되지 않아 계정이 Rate Limit을 초과하여 API 접근 권한이 차단될 수 있습니다.

최적의 해결책: 사이트 파일과 데이터베이스를 로컬에서 먼저 .tar.gz 형태의 단일 압축 파일로 묶은 다음, 그 단일 파일에 대해서만 업로드 요청을 수행하는 것입니다.

‘전체 스냅샷’ vs ‘데이터베이스 증분’:

이러한 무료 클라우드 스토리지에서 데이터베이스의 바이너리 로그(Binlog)를 활용한 실시간 증분 동기화를 시도하지 마십시오. 이는 전문적인 멀티 클라우드 아키텍처에나 적합합니다. 우리의 접근 방식은 매일 새벽 Cron 작업(스케줄러)을 이용해 ‘전체 스냅샷 압축’을 한 번 수행하고, 날짜로 이름을 지정하여 클라우드에 업로드한 뒤, 일정 기간이 지난 오래된 데이터는 삭제하는 것입니다. 단순함이 최고이며, 개인 사이트의 RTO(복구 시간 목표)를 달성하기에는 이것으로 충분합니다.

💡 vps1111 트러블슈팅 가이드 (무료 클라우드 스토리지의 숨겨진 위험):

- 용량 제한 경계선: Google Drive 무료 버전은 15GB에 불과합니다.

find명령어를 활용해 7일 또는 15일 이전의 오래된 백업을 정기적으로 삭제하시길 권장합니다. OneDrive E5는 용량이 크지만, 사용률이 너무 낮거나 순수 ‘콜드 백업용’으로 판정될 경우 Microsoft의 보안 시스템이 작동하여 데이터 삭제뿐만 아니라 계정 정지까지 당할 수 있습니다. 반드시 멀티 클라우드 분산 저장을 고려하십시오. - 테이블 락의 블랙홀: 트래픽이 많은 사이트에서 데이터베이스를 백업할 때

mysqldump를 실행하면 데드락(백업으로 인해 사이트가 일시적으로 접속되지 않는 현상)이 발생할 수 있습니다. 이 치명적인 함정을 피하려면 내보내기 명령어에 반드시--single-transaction매개변수를 추가해야 합니다! - 궁극의 데이터 프라이버시 및 해커 방어: 백업 파일이 퍼블릭 클라우드에 업로드된 후 클라우드 비밀번호가 유출되면 데이터베이스의 민감한 정보가 완전히 노출됩니다. 압축 시

openssl로 암호화하거나, 강력한 비밀번호가 설정된 zip을 사용하는 것을 강력히 권장합니다!

🛠️ 1단계: 긱(Geek)을 위한 최강의 선택 —— Rclone 마운트 및 전자동 스트림 동기화

깨끗한 SSH 접속 환경이 있고, LNMP나 Docker를 사용하며, 관리 패널에 의존하지 않는다면 이 Rclone 방식이 당신을 완벽하게 해방시켜 줄 것입니다. ‘클라우드 스토리지 관리의 맥가이버 칼’로 불리는 Rclone은 명령줄에서 주요 클라우드 API를 직접 호출할 수 있습니다.

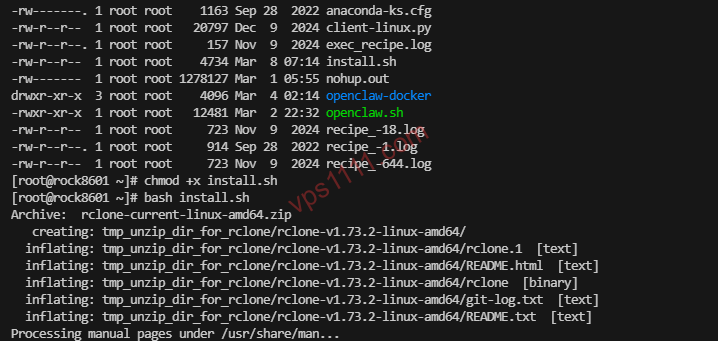

1. Rclone 코어 컴포넌트 원클릭 설치

공식 원클릭 설치 스크립트를 사용합니다. Ubuntu든 CentOS든 매우 안정적이며, SSH에서 직접 실행합니다:

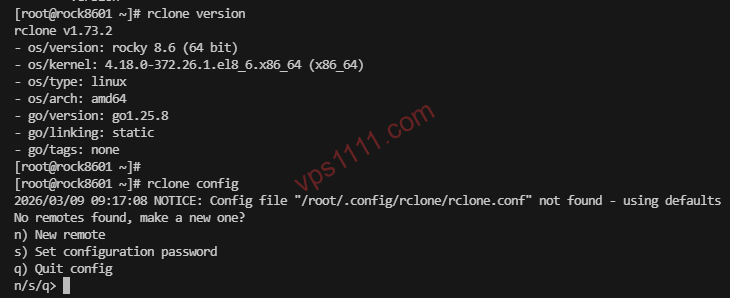

curl https://rclone.org/install.sh | sudo bash설치 완료 후 rclone version을 입력하여 버전 번호가 출력되는지 확인합니다.

2. Google Drive 또는 OneDrive 인증 설정

이 부분은 초보자가 가장 막히기 쉬운 곳입니다. 대부분의 VPS는 GUI가 없는(Headless) 서버이기 때문에, 브라우저를 열어 “로그인 승인”을 클릭할 수 없습니다. 따라서 현재 사용 중인 PC를 브릿지로 활용해야 합니다.

진행 순서:

명령어를 입력하여 대화형 메뉴로 들어갑니다:

rclone config- New remote: 새로운 연결 이름을 입력합니다. 예를 들어

gdrive또는onedrive로 지정합니다. - Storage Type: 긴 목록이 표시됩니다. Google Drive의 경우 해당하는 번호(보통

18주변)를 입력합니다. OneDrive의 경우 보통31입니다(실제 최신 프롬프트 번호를 따르세요). - Client ID / Client Secret: 여기서는 Enter를 눌러 건너뛰고 Rclone의 공용 API를 기본으로 사용합니다. 단, 안정성을 높이려면 나중에 Google Cloud Console에서 전용 키를 신청하는 것을 강력히 권장합니다(고급 사용자용).

- Scope:

1(전체 읽기/쓰기 권한 부여)을 선택합니다. - Use auto config?: 시스템이 자동 구성을 사용할지 묻습니다. 중요: 브라우저가 없으므로 여기서는

N(아니오)을 선택해야 합니다!

이어서 시스템이 안내 명령어를 표시합니다:

For this to work, you will need rclone available on a machine that has a web browser available.

의미: 데스크톱 OS가 설치된 PC(예: 현재 사용 중인 컴퓨터)에 로컬 버전의 rclone 도구를 다운로드하고, cmd에서 안내된 명령어 rclone authorize "drive" "xxxxxxxx"를 입력해야 합니다.

그러면 로컬 PC에서 브라우저 창이 팝업됩니다. 클라우드 계정에 로그인하여 권한 부여를 완료하면, 명령 프롬프트에 매우 중요한 Token JSON 코드 문자열이 반환됩니다.

이 아주 긴 코드를 복사하여, 인증을 기다리고 있는 VPS 서버의 터미널에 붙여넣으면 마운트가 완료됩니다。

3. 자동화의 핵심 골격: 코어 Shell 스크립트 작성

Rclone 환경이 준비되면, 서버에 “무엇을 패키징하고, 어디에 저장하며, 클라우드에 어떻게 보낼 것인지”를 지시해야 합니다.

VPS의 /root 디렉터리에 전용 스크립트를 생성합니다:

mkdir -p /root/scripts

mkdir -p /root/backup_temp

nano /root/scripts/auto_backup.sh아래의 최상급 코드를 본인의 설정에 맞게 수정하여 붙여넣으십시오. (주의: 여기서는 환경 변수를 사용하여 비밀번호를 전달하는 고급 보안 규범을 적용하여, ps 프로세스를 통한 데이터베이스 비밀번호 유출 위험을 원천 차단했습니다):

#!/bin/bash

# ==========================================

# 데이터베이스 및 웹사이트 소스 코드를 Google Drive로 자동 백업

# ==========================================

# 1. 변수 정의 영역 (본인의 데이터로 변경하세요)

DB_USER="root"

# 핵심 보안 규범: ps -ef에 의한 유출을 방지하고 명령줄 경고를 없애기 위해 비밀번호를 환경 변수로 전달

export MYSQL_PWD="데이터베이스의 강력한 비밀번호"

DB_NAME="데이터베이스 이름"

# 웹사이트 파일도 백업하려면 전체 경로를 입력

WEB_DIR="/var/www/html"

# Rclone 마운트 이름과 클라우드 저장 경로

RCLONE_REMOTE="gdrive:ServerBackup"

# 임시 저장 디렉터리 (반드시 미리 생성해 두어야 함)

BACKUP_DIR="/root/backup_temp"

# 날짜 및 시간 태그 생성

DATE=$(date +"%Y%m%d_%H%M%S")

DB_FILE="$BACKUP_DIR/db_$DB_NAME_$DATE.sql"

ARCHIVE_FILE="$BACKUP_DIR/full_web_backup_$DATE.tar.gz"

echo "[시작] $(date) - 대규모 방폭 백업 프로세스 트리거"

# 2. 데이터베이스 내보내기 (핵심 팁: --single-transaction 및 --routines 추가)

echo "[진행 중] MySQL 데이터베이스를 덤프하는 중..."

mysqldump -u$DB_USER --single-transaction --routines --triggers $DB_NAME > $DB_FILE

# 3. 사이트 파일과 데이터베이스 덤프를 혼합하여 압축

echo "[진행 중] 파일을 tar.gz 고압축 아카이브로 묶는 중..."

tar -czvf $ARCHIVE_FILE $WEB_DIR $DB_FILE

# 4. 원격 전송 및 Google Drive로 업로드

echo "[진행 중] Rclone을 통해 클라우드에 업로드할 준비 중..."

rclone copy $ARCHIVE_FILE $RCLONE_REMOTE

# 5. 로컬 디스크 용량 초과 방지: 임시 파일 및 오래된 파일 삭제 (빠른 복구를 위해 로컬에 3일분 유지)

echo "[정리] 서버에 남은 임시 파일을 정리하는 중..."

rm -f $DB_FILE

find $BACKUP_DIR -name "*.tar.gz" -type f -mtime +3 -exec rm {} \;

echo "[완료] 백업 및 업로드 라이프사이클이 종료되었습니다!"저장 후 이 스크립트에 실행 권한을 부여합니다:

chmod +x /root/scripts/auto_backup.sh즉시 수동으로 한 번 실행해 보는 것을 권장합니다: /root/scripts/auto_backup.sh. 화면에 에러 없이 진행되는 것을 확인한 후, Google Drive에 새로운 파일이 저장되었는지 확인하십시오.

4. Crontab을 통한 초 단위 스케줄링으로 완전 무인 자동화

명령어를 실행합니다:

crontab -e파일 맨 아래에 다음 줄을 추가합니다 (이는 웹사이트 트래픽이 가장 적은 매일 새벽 3시 30분에 백업을 시작함을 의미합니다):

30 3 * * * /root/scripts/auto_backup.sh > /root/scripts/backup.log 2>&1이것으로 완료되었습니다. 제로부터 수동으로 구축한 이 일련의 시스템은 의심할 여지 없이 가장 궁극적이고 순수한 방법이며, 성능 오버헤드도 서버에 불필요한 부하를 거의 주지 않습니다.

🖥️ 2단계: 비기술직 웹마스터를 위한 — 관리 패널 (aaPanel 등) 원클릭 연동

검은 명령창과 씨름하고 싶지 않더라도 괜찮습니다. 현재 서버에 aaPanel(또는 1Panel 등)이 설치되어 있다면, 공식 무료/유료 플러그인이 이미 게이트웨이를 구축해 두어 초보자에게 이보다 더 친절할 수 없습니다.

1단계: 소프트웨어 스토어에서 인증 플러그인 검색

패널 백엔드의 ‘소프트웨어 스토어(App Store)’에 접속하여 “Google Drive” 또는 “OneDrive”를 검색합니다. 공식 인증된 백업 플러그인을 설치합니다.

2단계: 브라우저 기반의 간편한 인증

설치 완료 후 ‘설정’을 클릭합니다. 패널에 내장된 웹 브라우저 프록시 덕분에, 인증 버튼을 누르고 페이지의 안내에 따라 데이터를 저장할 Google 계정에 로그인한 뒤 “허용”을 클릭하기만 하면 Token이 패널 서버와 자동으로 양방향 연동됩니다.

3단계: 매우 엄격한 예약 작업(Cron) 추가

왼쪽 메뉴의 ‘예약 작업(Cron)’으로 이동합니다. 여기가 바로 VPS 운영 전문가의 진가가 발휘되는 곳입니다:

- 작업 유형: “데이터베이스 백업” 또는 “웹사이트 백업”을 선택합니다. 각각 독립된 작업으로 두 개를 만드는 것을 권장합니다.

- 실행 주기: 매일 새벽 4:00로 설정합니다. 이 시간이면 글로벌 트래픽도 심야에 접어들어 트래픽이 가장 적은 시간대입니다.

- 백업 대상: 드롭다운 메뉴에서 방금 인증을 마친 Google Drive 또는 OneDrive를 선택합니다!

- 최신 항목 유지: 반드시 “7개” 또는 “15개”를 입력하십시오!!! 절대 0이나 빈칸으로 두지 마십시오. 제한을 두지 않으면 매일 쌓이는 백업이 클라우드 스토리지를 꽉 채워 결국 서비스가 정지되는 돌이킬 수 없는 결과를 낳습니다.

저장 후 예약 작업 목록에서 수동으로 “실행” 버튼을 클릭해 봅니다. 로그를 확인하여 “업로드 성공” 등의 메시지가 보이면 이 사이클이 정상적으로 개통된 것입니다.

🔄 백엔드 환류 전술 — 재난 발생 시 긴급 복구는 어떻게 하는가?

복구 절차가 없는 백업 가이드는 전형적인 “파놓고 묻지 않는” 무책임한 글입니다. 만약 미래에 서버가 다운되어 새로운 서버를 구매했다면, 어떻게 데이터를 구출해야 할까요?

Rclone 방식을 사용하는 경우:

새 서버에서 동일한 rclone config 설정을 완료한 후, 업로드 때처럼 복잡한 과정 없이 아래의 pull 명령어로 로컬에 직접 가져옵니다:

rclone copy gdrive:ServerBackup/full_web_backup_20261111.tar.gz /root/restore/다운로드 완료 후 압축을 풀고, 표준 명령어를 통해 데이터베이스를 강제 임포트합니다:

mysql -u root -p 새로_만든_빈_데이터베이스_이름 < /root/restore/db_xxxx.sql관리 패널(aaPanel 등)을 사용하는 경우:

새 서버에 동일한 관리 패널과 백업 플러그인을 설치하고 다시 인증을 완료합니다. 그런 다음 “백업 관리”에서 원하는 날짜의 클라우드 백업 버전을 선택하고 【복원(Restore)】을 클릭하기만 하면 됩니다. 이 부드러운 경험은 초보자의 심리적 부담을 크게 덜어줍니다。

❓ 자주 묻는 질문 (FAQ)

매일 이렇게 거대한 백업 압축 파일을 업로드하면, 서버의 대역폭과 CPU를 대량으로 소비하여 사이트가 다운되지 않나요?

이것은 매우 중요한 기술적 질문입니다. mysqldump로 패키징하거나 tar를 실행하는 동안 실제로 CPU 사용량이 치솟습니다. 만약 1Core 1GB의 경량 서버를 사용 중이라면, 스크립트 내에서 nice -n 19 tar -czvf ... 와 같이 작성하여 패키징 프로세스의 시스템 우선순위를 최하로 낮추고 일반 웹 사용자의 요청을 우선 처리하게 하는 것을 권장합니다. 또한 대역폭이 거의 사용되지 않는 유휴 시간대인 새벽에 스크립트를 실행하는 것이 최선입니다。

무료 용량이 15GB밖에 안 되는데, 사이트 데이터가 이미 20GB를 넘었습니다. 어떻게 해야 하나요?

이는 물리적인 저장 공간의 한계입니다. 해결책은 세 가지입니다. 첫째, 대용량 OneDrive 계정을 구매하여 대체합니다. 둘째, 위 Rclone 스크립트 구조를 수정하여 사이트 파일 중 거대한 미디어 디렉터리를 제외(--exclude "wp-content/uploads/*" 매개변수 추가)하고 핵심 자산인 순수 데이터베이스만 백업합니다(텍스트와 설정이 가장 중요하기 때문입니다). 셋째, 여러 개의 Google 계정을 연동하고 트래픽을 분산시키는 스크립트를 작성합니다。

클라우드 백업이 Google 공식에 의해 API 남용이나 규정 위반으로 간주되지 않나요?

정기 스냅샷의 원칙(예: 하루 1~2회의 대형 압축 파일 업로드)을 엄격히 지킨다면, 규정 위반으로 판정받을 일은 절대 없습니다. 공식 API가 가장 싫어하는 것은 1초에 수백 번씩 무의미한 작은 파일들의 동기화 요청을 빈번하게 보내는 것입니다(그래서 tar로 전체를 하나로 묶는 것을 강조한 것입니다). 규범에 따라 조작한다면 계속 사용하더라도 전혀 문제가 되지 않습니다。

MySQL을 Docker 컨테이너로 배포한 경우, 호스트 머신에서 백업 스크립트를 어떻게 실행하나요?

코드 한 줄만 살짝 수정하면 됩니다. 호스트 머신에서 직접 mysqldump를 실행하는 대신, docker의 exec 레이어를 활용해 관통 실행합니다: docker exec container_name mysqldump -uroot -ppassword database > backup.sql. (참고: 컨테이너 내부 실행 시에도 유출 방지를 위해 MYSQL_PWD 환경 변수를 통한 패스워드 전달을 권장합니다). 나머지 패키징 및 Rclone 업로드 명령어 로직은 전혀 변경할 필요가 없습니다。