核心要約:2026年現在、VPS事業者の「システムスナップショット」だけに依存するのは、データを「丸裸」で放置するのと同じです。データセンターの火災、ディスク障害、または誤操作により、サイトは一瞬で消滅するリスクがあります。本記事では、無料の Google ドライブ または OneDrive のスペースを活用し、Rcloneコマンドや管理パネルのプラグインと組み合わせて、コストゼロ・全自動・高耐久な異地(オフサイト)データベース&サイトファイルバックアップシステムを構築する方法を技術的に徹底解説します。トークン更新の仕組み、API制限の回避、単一ファイルの暗号化圧縮、テーブルロック防止、プロセスのパスワード漏洩防止など、必須のトラブル回避ガイドも網羅しています。

率直に言って、2026年になってもサーバーを「丸裸」の状態で運用したり、VPS事業者の「システムスナップショット」だけに依存しているのは、非常にリスクが高いと言わざるを得ません。BandwagonHost、Spartan、RackNerdなど、どのVPSを使用していても、適切なオフサイトバックアップを行っていなければ、運を天に任せているようなものです。データセンターの火災、ディスクの故障、事業者の突然のサービス終了、あるいは自分自身の rm -rf /* という操作ミスひとつで、長年積み上げてきたWordPressブログやビジネスサイトのデータは一瞬で灰燼に帰します。AWS S3や阿里雲(Alibaba Cloud)OSSのような企業向けバックアップは堅牢ですが、個人運営や小規模ビジネスにとっては設定が複雑で、転送量やストレージの従量課金も無視できない出費となります。

実は、バックアップに多額の費用をかける必要はありません。手元にある無料の Google ドライブ(15GBの無料枠)や OneDrive(Office 365の1TBやE5アカウント等)を活用し、数行の自動化スクリプトやパネルのプラグインを組み合わせるだけで、コストゼロ・全自動・高耐久なデータ避難所を構築できます。一度設定してしまえば「一生モノ」の恩恵が得られ、万が一サーバーが爆発したとしても、数十分以内に完全復旧が可能です。もしあなたが今も信頼できるバックアップ方法を探しているなら、この実践的な完全ガイドがVPS運用における生存戦略の核心となるでしょう。

この記事では、サーバー上のMySQL/MariaDBデータベースとサイトソースファイルを、異なる手法(コマンドラインまたはパネル環境)を通じて Google ドライブ や OneDrive へ全自動同期する方法を徹底解析します。手順だけでなく、クラウド業界の「専門用語」や陥りやすい罠も解説し、データの安全を万全なものにします。

📊 主要クラウドストレージのバックアップ戦略とソリューション比較

実践に移る前に、現在どのような手法があるのかを確認しましょう。以下の比較表から、自分に合った学習コストと効果のバランスを選んでください。

🔥 主要クラウドデータベースバックアップ手法 PK(エキスパートは Rclone を強く推奨)

| バックアップ手法 | 学習コスト | セキュリティ・暗号化対応 | 柔軟性とスケジュール機構 | 主な対象ユーザー |

|---|---|---|---|---|

| Rclone + Crontabスクリプト | ⭐高い (Linuxの知識が必要) | 高度なストリーム暗号化に対応、死角なし | 極めて高い (秒単位のカスタマイズ、構造制限なし) | パワーユーザー / 単体VPS |

| 管理パネル (宝塔/1Panel等) プラグイン | ⭐低い (GUIで完結) | 圧縮ファイルのパスワードに依存、突破されやすい | 一般的、パネルのバージョン設定に依存 | 非技術系のサイト運営者 |

| UpdraftPlus (WPプラグイン) | ワンクリックで簡単連携 | 弱い (WP自体のセキュリティに依存) | WordPressの特定ディレクトリのみ | 純粋なWPブロガー (初心者) |

中規模以下のWPブログやビジネスサイトを運営しており、一度の設定で永続的に運用し、すべての基盤データロジックを制御したいのであれば、派手なプラグインを捨てて Rclone + 自動化スクリプト を選ぶのが「最強」の選択肢です。

🧠 核心原理の解析と技術的な前提条件

過去にスクリプトでクラウドストレージへ同期しようとして、数日で止まってしまった経験はありませんか?安定して運用するためには、クラウドコンピューティングの重要なルールとバックエンドの論理を理解する必要があります。

OAuth 2.0 認証とトークンの更新メカニズム:

Rcloneやパネルのプラグインなどのアプリケーションが Google ドライブ にアクセスする際、クラウド側はパスワードを直接保存せず「Access Token」と「Refresh Token」を発行します。Access Tokenの有効期限は通常数時間です。初心者のバックアップが失敗する原因の多くは、ツールがRefresh Tokenを自動処理できずデッドロックに陥るためです。推奨するRcloneや正規のパネルプラグインの最大の強みは、極めて堅牢なトークン自動更新機能を備えている点です。

API レート制限 (Rate Limits):

サイト内の何万個にも及ぶ小さなファイル(画像、キャッシュの断片コードなど)を直接 Google ドライブ や OneDrive へ同期してはいけません!クラウドのAPIには厳格なリクエスト頻度制限があります。ディレクトリ全体を直接同期するコマンドを実行すると、30分も経たないうちにRate Limitに達し、APIアクセス権限が凍結されます。

最適な解決策: サイトファイルとデータベースをローカルで一度 .tar.gz の単一圧縮ファイルにまとめ、その単一ファイルに対してアップロードリクエストを行うことです。

「フルスナップショット」と「データベース増分」:

無料のクラウドストレージでデータベースのバイナリログ(Binlog)を用いたリアルタイム増分同期を試みるのはやめましょう。それはプロフェッショナルなマルチクラウドアーキテクチャ向けの技術です。我々のアプローチは、毎日深夜にCronジョブを利用して「フルスナップショットの圧縮」を1回行い、日付で命名してクラウドへ投げ、一定期間を過ぎた古いデータは直接削除するというものです。シンプルイズベストであり、個人サイトのRTO(目標復旧時間)としてはこれで完全に十分です。

💡 vps1111 トラブル回避ガイド(無料クラウドストレージの隠れたリスク):

- 容量制限の警戒線: Google ドライブ の無料版は15GBしかありません。

findコマンドを組み合わせて、7日または15日前の古いバックアップを定期的に削除することを推奨します。OneDrive E5 は大容量ですが、使用率が低すぎたり純粋な「コールドストレージ」と判定されたりすると、Microsoftのセキュリティシステムが発動し、データが消去されるだけでなくアカウントが凍結されるリスクがあります。必ずマルチクラウドでの分散を心がけてください。 - テーブルロックのブラックホール: 高トラフィックなサイトでデータベースをバックアップする際、

mysqldumpを実行するとデッドロック(バックアップが原因でサイトが一時的にダウンして開けなくなる現象)が発生する可能性があります。この致命的な落とし穴を回避するため、エクスポートコマンドには必ず--single-transactionパラメータを追加してください! - 究極のデータプライバシーとハッカー対策: バックアップファイルがパブリッククラウドに送信された後、もしクラウドのパスワードが漏洩すれば、データベースの機密情報が完全に露出します。パッキング時に

opensslで暗号化するか、強力なパスワード付きの zip を使用することを強く推奨します!

🛠️ 第1段階:ギーク推奨の最強プラン —— Rclone マウントと全自動ストリーム同期

クリーンなSSH接続環境があり、LNMPやDockerを使用し、管理パネル環境に依存しない場合、このRcloneを使った手法があなたを完全に解放します。「クラウドストレージ管理のアーミーナイフ」と称されるRcloneは、コマンドラインから主要なクラウドのAPIを直接呼び出すことができます。

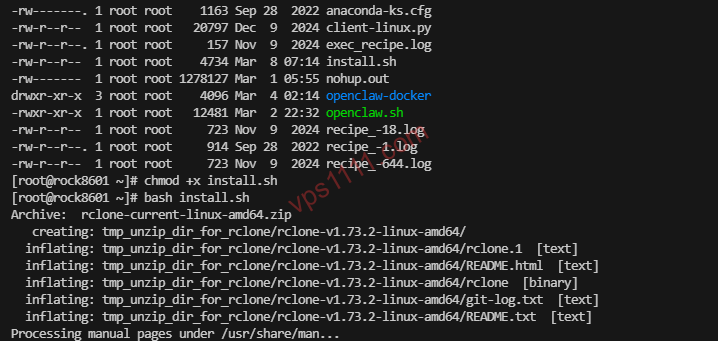

1. Rclone コアコンポーネントのワンクリックインストール

公式のワンクリックインストールスクリプトを使用します。UbuntuでもCentOSでも極めて安定しており、SSHで直接以下を実行します:

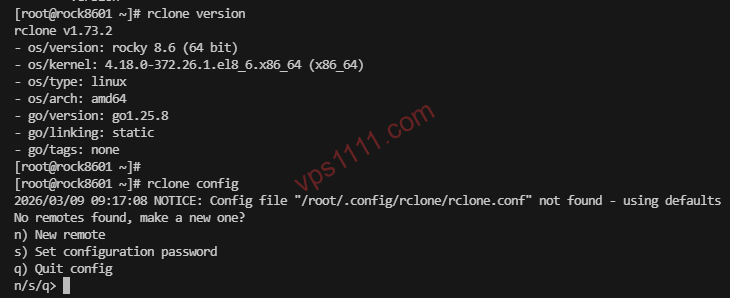

curl https://rclone.org/install.sh | sudo bashインストール完了後、rclone version と入力してバージョン番号が出力されるか確認します。

2. Google ドライブ または OneDrive の認証設定

ここは初心者が最もつまずきやすい部分です。VPSの多くはGUIを持たない(Headless サーバー)ため、ブラウザを開いて「ログインを承認」することができません。そこで、手元のPCをブリッジとして利用します。

手順の概要:

コマンドを入力してインタラクティブなメニューに入ります:

rclone config- New remote: 新しい接続名を入力します。例えば

gdriveやonedriveと名付けます。 - Storage Type: 長いリストが表示されます。Google Drive の場合は対応する番号(通常は

18前後)を入力します。OneDrive の場合は通常31です(実際の最新のプロンプトの数字に従ってください)。 - Client ID / Client Secret: ここはEnterキーを押してスキップし、RcloneのパブリックAPIをデフォルトで使用します。ただし、安定性を高めるため、後で Google Cloud Console で専用キーを申請することを強くお勧めします(上級者向け)。

- Scope:

1(フルアクセス権限の付与)を選択します。 - Use auto config?: システムが自動構成を使用するか尋ねてきます。重要:ブラウザがないため、ここは

N(いいえ)を選択します!

次に、システムは以下の案内コマンドを表示します:

For this to work, you will need rclone available on a machine that has a web browser available.

意味:デスクトップOSを搭載したマシン(例:手元のパソコン)にローカル版のrcloneツールをダウンロードし、コマンドプロンプトで指示されたコマンド rclone authorize "drive" "xxxxxxxx" を入力する必要があります。

その後、ローカルマシンでブラウザウィンドウがポップアップします。クラウドアカウントにログインして認証を完了すると、コマンドプロンプトに非常に重要な Token JSON コード の長い文字列が返されます。

この超長いコードをコピーし、VPSサーバーの認証待ちのステップに貼り付ければマウント完了です。

3. 自動化の魂となる骨格:コア Shell スクリプトの作成

Rclone環境が整ったら、「何をパッケージ化し、どこに保存し、どうやってクラウドに投げるか」をサーバーに指示する必要があります。

VPSの /root ディレクトリに専用のスクリプトを作成します:

mkdir -p /root/scripts

mkdir -p /root/backup_temp

nano /root/scripts/auto_backup.sh以下の核兵器級のコードを自分の設定に合わせて変更し、貼り付けてください。(注意:ここでは環境変数を使ってパスワードを渡す高度なセキュリティ規範を採用しており、ps プロセスによるデータベースパスワード漏洩のリスクを排除しています):

#!/bin/bash

# ==========================================

# データベースとウェブサイトのソースコードを Google Drive へ自動バックアップ

# ==========================================

# 1. 変数定義エリア(自分のデータに置き換えてください)

DB_USER="root"

# コアセキュリティ規範:ps -efによる漏洩やコマンドライン警告を防ぐため、パスワードは環境変数経由で渡す

export MYSQL_PWD="あなたのデータベースの強力なパスワード"

DB_NAME="あなたのデータベース名"

# サイトのファイルをバックアップする場合は完全なパスを入力

WEB_DIR="/var/www/html"

# Rcloneのマウント名とクラウドの保存先パス

RCLONE_REMOTE="gdrive:ServerBackup"

# 一時保存ディレクトリ(必ず事前に作成しておくこと)

BACKUP_DIR="/root/backup_temp"

# 日付・時間タグの生成

DATE=$(date +"%Y%m%d_%H%M%S")

DB_FILE="$BACKUP_DIR/db_$DB_NAME_$DATE.sql"

ARCHIVE_FILE="$BACKUP_DIR/full_web_backup_$DATE.tar.gz"

echo "[開始] $(date) - 大規模防爆バックアッププロセスをトリガー"

# 2. データベースのエクスポート(回避の要点:--single-transaction と --routines を追加)

echo "[進行中] MySQLデータベースをダンプしています..."

mysqldump -u$DB_USER --single-transaction --routines --triggers $DB_NAME > $DB_FILE

# 3. サイトファイルとデータベースダンプの混合パッケージ化

echo "[進行中] ファイルを tar.gz の高圧縮アーカイブにまとめています..."

tar -czvf $ARCHIVE_FILE $WEB_DIR $DB_FILE

# 4. リモート転送と Google Drive へのアップロード

echo "[進行中] Rclone 経由でクラウドにアップロードする準備をしています..."

rclone copy $ARCHIVE_FILE $RCLONE_REMOTE

# 5. ローカルディスクのパンク防止:一時ファイルと古いファイルを削除(高速復旧用にローカルには3日分保持)

echo "[クリーンアップ] サーバーに残った一時ファイルを削除しています..."

rm -f $DB_FILE

find $BACKUP_DIR -name "*.tar.gz" -type f -mtime +3 -exec rm {} \;

echo "[完了] バックアップとアップロードのライフサイクルが終了しました!"保存し、このスクリプトに実行権限を与えます:

chmod +x /root/scripts/auto_backup.shすぐに手動で一度実行してみることをお勧めします:/root/scripts/auto_backup.sh。画面がエラーなくスクロールするのを見届けたら、Google ドライブ に新しいファイルが保存されているか確認してください。

4. Crontab による秒単位の定期実行で、完全無人稼働状態へ

以下のコマンドを実行します:

crontab -eファイルの最下部に以下の行を追加します(これは、サイトのアクセス数が最も少なくなる毎日深夜3:30にバックアップを開始することを意味します):

30 3 * * * /root/scripts/auto_backup.sh > /root/scripts/backup.log 2>&1これで完了です。ゼロから手作業で構築したこの一連のシステムは、間違いなく最も究極でピュアな方法であり、パフォーマンスのオーバーヘッドもサーバーに余計な変動を与えることはありません。

🖥️ 第2段階:非技術系のサイト運営者向け —— 管理パネル (宝塔/1Panel 等) でのワンクリック連携

誰もが真っ黒なコマンドラインと格闘したいわけではありません。現在のサーバーに既に宝塔パネル(または 1Panel などの管理パネル)が導入されている場合、公式の無料/有料プラグインがすでにゲートウェイを構築しており、初心者にはこれ以上ないほど親切です。

ステップ1:ソフトウェアストアで認証プラグインを検索

管理パネルのバックエンドに入り、「ソフトウェアストア(アプリストア)」で「Google Drive」または「OneDrive」を検索します。対応する公式のバックアッププラグインをインストールします。

ステップ2:ブラウザベースの簡単な認証

プラグインのインストール完了後、「設定」をクリックします。パネル内蔵のWebブラウザプロキシ機能のおかげで、パネル上の認証ボタンをクリックし、ページのリダイレクトに従ってデータを保存したいGoogleアカウントにログインし「許可」をクリックするだけで、Tokenがパネルのサーバーと自動的に双方向で紐付けられます。

ステップ3:極めて厳格なスケジュールタスクの追加

左側のメニューから「スケジュールタスク(Cronジョブ)」に入ります。ここがVPS運営のエキスパートとしての腕の見せ所です:

- タスクタイプ: 「データベースのバックアップ」または「サイトのバックアップ」を選択します。それぞれ専用の独立したタスクを作成することをお勧めします。

- 実行サイクル: 毎日深夜 4:00 に設定します。この時間帯であれば、海外向けサイトであっても欧米地域は夜間となり、トラフィックが最低になる谷間です。

- バックアップ先: ドロップダウンメニューから、先ほど認証した Google Drive または OneDrive を選択します!

- 保持する最新の数: 必ず「7部」または「15部」と入力してください!!! 絶対に0にしたり空欄のままにしないでください。制限を設けないと、日々のバックアップでクラウドストレージがパンクし、最終的にはサービスが一時停止されて取り返しがつかなくなります。

送信ボタンをクリックした後、すぐにタスクリスト内の「実行」ボタンを手動でクリックしてください。ログを確認し、「アップロード成功」などの文字が表示されれば、このサイクルは正常に開通したことになります。

🔄 バックエンドの還流戦術 —— 障害発生時の緊急復旧方法は?

復旧手順のないバックアップガイドは「掘りっぱなしで埋めない」典型例です。もし将来サーバーがクラッシュし、新しいマシンを購入した場合、どのように救出すべきでしょうか?

Rcloneを利用している場合:

新マシンで同じ rclone config を再設定した後、アップロードのように複雑なことはせず、以下のプルコマンドでローカルに直接引き戻します:

rclone copy gdrive:ServerBackup/full_web_backup_20261111.tar.gz /root/restore/ダウンロード完了後、解凍し、以下のコマンドでデータベースへ強制インポートします:

mysql -u root -p 新しく作成した空のデータベース名 < /root/restore/db_xxxx.sql管理パネル (宝塔など) を利用している場合:

同様に新しい管理パネルをインストールした後、同じバックアッププラグインを入れ、再度認証を完了させます。その後、「バックアップ管理」から目的の日付のクラウドバックアップ版を選択し、【復元 (Restore)】をクリックするだけです。このスムーズな体験は、初心者にとって心理的な負担を大幅に軽減します。

❓ よくある質問 (FAQ)

毎日巨大なバックアップ圧縮ファイルをアップロードすると、サーバーの帯域幅やCPUを大量に消費し、サイトがダウンしませんか?

これは非常に重要な技術的質問です。mysqldump によるパッケージ化や tar の実行中には、確かにCPUスパイクが発生します。もし1Core 1GBの軽量サーバーを使用している場合は、スクリプト内で nice -n 19 tar -czvf ... のように記述してパッケージ化プロセスのシステム優先度を最低に下げ、通常のWebユーザーのリクエストを優先させることをお勧めします。また、スクリプトは深夜に実行し、帯域幅が完全にアイドリング状態でフルに使われない時間帯を狙うのがベストです。

無料の15GBしか容量がないのですが、サイトのデータがすでに20GBを超えています。どうすればいいですか?

これは物理的な制限による壁です。解決策は3つあります。第一に、大容量の OneDrive アカウントを購入して代替とする。第二に、上記の Rclone スクリプトの構造を変更し、サイトファイルのうち巨大なメディアディレクトリを除外する(--exclude "wp-content/uploads/*" パラメータを追加)。コア資産は通常テキストと設定にあるため、純粋なデータベースのみをバックアップします。第三に、複数の Google アカウントをマウントし、負荷分散するスクリプトを書くことです。

クラウドバックアップは、Google公式からAPIの乱用や規約違反とみなされませんか?

定期的なスナップショットの原則(例:1日に1〜2回の巨大な圧縮ファイルのアップロード)を厳格に守っている限り、規約違反と判定されることは絶対にありません。公式APIが最も嫌うのは、1秒間に何百回も無意味な小さなファイルの同期リクエストを頻繁に送信することです(だからこそ tar で全体をパッケージ化することを強調しています)。規範に従って操作すれば、継続して使用しても完全に問題ありません。

MySQLをDockerコンテナで展開している場合、ホストマシンでバックアップスクリプトをどう実行すればよいですか?

コードを1行少し変更するだけです。ホストマシンで直接 mysqldump をトリガーするのではなく、docker の exec レイヤーを利用して貫通実行します:docker exec container_name mysqldump -uroot -ppassword database > backup.sql。(注:コンテナ内での実行でも、漏洩を防ぐために MYSQL_PWD 環境変数を利用してパラメータを渡すことを推奨します)。その後のパッキングやRcloneアップロードコマンドのロジックは一切変更する必要はありません。